Pytorch模型训练技巧--warmup

pytorch中的学习率调节策略

(1)等间隔调整学习率 StepLR

(2)按需调整学习率 MultiStepLR

(3)指数衰减调整学习率 ExponentialLR

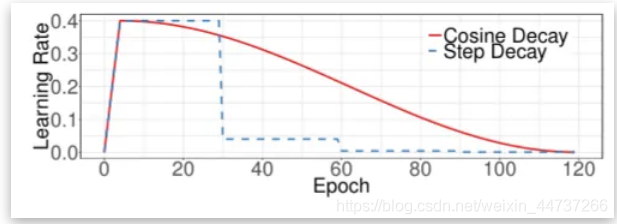

(4)余弦退火调整学习率 CosineAnnealingLR

(5)自适应调整学习率 ReduceLROnPlateau

(6)自定义调整学习率 LambdaLR

实际中学习率调节策略

在顶会论文和知名比赛中,作者一般都不会直接使用上述学习率调整策略,而是先预热模型(warm up), 即以一个很小的学习率逐步上升到设定的学习率,这样做会使模型的最终收敛效果更好。

代码实现

https://butui.me/post/lamdalr-in-pytorch/