ClickHouse学习

ClickHouse

一.概述

1.特点

ClickHouse 是俄罗斯的 Yandex 于 2016 年开源的列式存储数据库(DBMS),使用

C++语言编写,主要用于在线分析处理查询(OLAP),能够使用 SQL 查询实时生成分析

数据报告

OLAP适合一次写入,多次读取

OLTP可以增删改查,因为有事务支持

1.列式存储

2.DBMS 的功能

几乎覆盖了标准 SQL 的大部分语法,包括 DDL 和 DML,以及配套的各种函数,用户管理及权限管理,数据的备份与恢复

3.多样化引擎

ClickHouse 和 MySQL 类似,把表级的存储引擎插件化,根据表的不同需求可以设定不同的存储引擎。目前包括合并树、日志、接口和其他四大类 20 多种引擎

4.高吞吐写入能力

ClickHouse 采用类 LSM Tree 的结构,数据写入后定期在后台 Compaction。通过类LSM tree 的结构,ClickHouse 在数据导入时全部是顺序 append 写,写入后数据段不可更改,在后台 compaction 时也是多个段 merge sort 后顺序写回磁盘。顺序写的特性,充分利用了磁盘的吞吐能力,即便在 HDD 上也有着优异的写入性能。官方公开 benchmark 测试显示能够达到 50MB-200MB/s 的写入吞吐能力,按照每行 100Byte 估算,大约相当于 50W-200W 条/s 的写入速度

5.数据分区与线程级并行

ClickHouse 将数据划分为多个 partition,每个 partition 再进一步划分为多个 index granularity(索引粒度),然后通过多个 CPU 核心分别处理其中的一部分来实现并行数据处理。在这种设计下,单条 Query 就能利用整机所有 CPU。极致的并行处理能力,极大的降低了查询延时

所以,ClickHouse 即使对于大量数据的查询也能够化整为零平行处理。但是有一个弊端就是对于单条查询使用多 cpu,就不利于同时并发多条查询。所以对于高 qps 的查询业务,ClickHouse 并不是强项

2.安装

2.1 安装前准备

(1)确定防火墙处于关闭状态

(2)CentOS 取消打开文件数限制

在 hadoop102 的 /etc/security/limits.conf 文件的末尾加入以下内容

sudo vim /etc/security/limits.conf

* soft nofile 65536

* hard nofile 65536

* soft nproc 131072

* hard nproc 131072

在 hadoop102 的/etc/security/limits.d/20-nproc.conf 文件的末尾加入以下内容

sudo vim /etc/security/limits.d/20-nproc.conf

* soft nofile 65536

* hard nofile 65536

* soft nproc 131072

* hard nproc 131072

分发到另外两天机器

sudo /home/gzhu/bin/xsync /etc/security/limits.conf

sudo /home/gzhu/bin/xsync /etc/security/limits.d/20-nproc.conf

(3)三台机器安装依赖

sudo yum install -y libtool

sudo yum install -y *unixODBC*

(4)CentOS 取消 SELINUX(三台机器都要)

SELINUX=disabled

(5)重启三台服务器

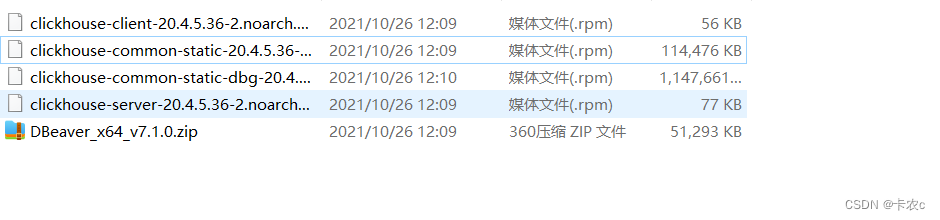

2.2 正式安装

安装资料

链接:https://pan.baidu.com/s/10UxBTen44ALCLo0kOKIiZA

提取码:sgo0

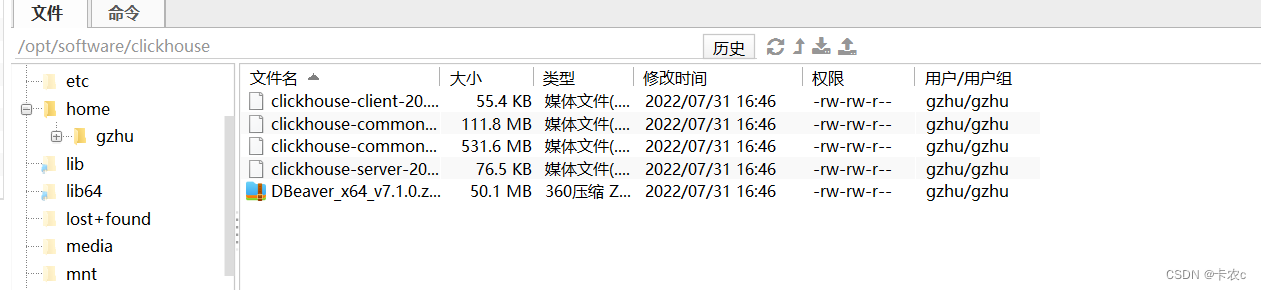

上传到hadoop102

分发

xsync /opt/software/clickhouse

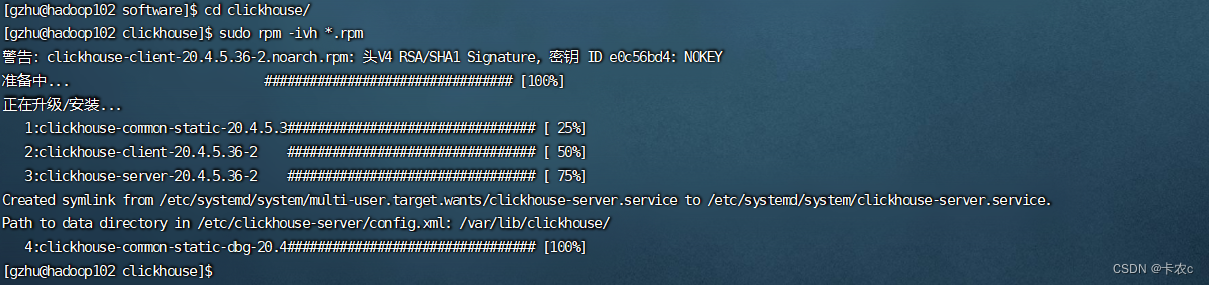

分别在三台机子上安装这 4 个 rpm 文件

[gzhu@hadoop102 clickhouse]$ sudo rpm -ivh *.rpm

[gzhu@hadoop103 clickhouse]$ sudo rpm -ivh *.rpm

[gzhu@hadoop104 clickhouse]$ sudo rpm -ivh *.rpm

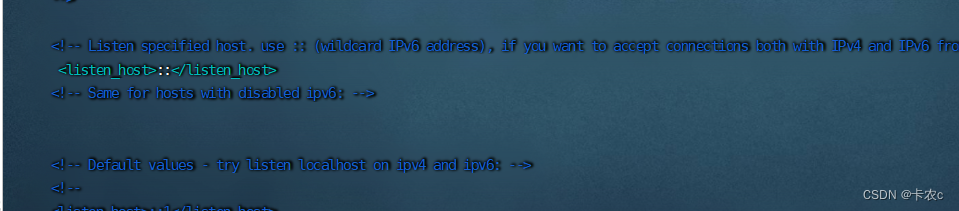

修改配置文件并分发

sudo vim /etc/clickhouse-server/config.xml

把 <listen_host>::</listen_host> 的注释打开,这样的话才能让 ClickHouse 被除本机以外的服务器访问

sudo /home/gzhu/bin/xsync /etc/clickhouse-server/config.xml

在这个文件中,有 ClickHouse 的一些默认路径配置,比较重要的

数据文件路径:

日志文件路径:/var/log/clickhouse-server/clickhouse-server.log

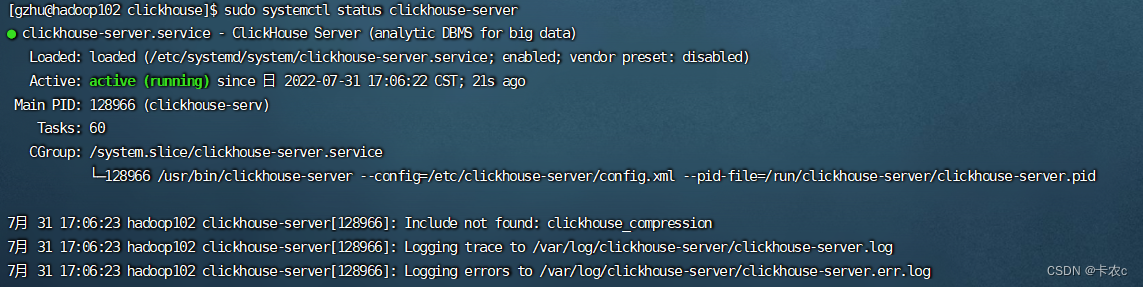

启动 Server

[gzhu@hadoop102 clickhouse]$ sudo systemctl start clickhouse-server

查看状态

三台机器上关闭开机自启

[gzhu@hadoop102 clickhouse]$sudo systemctl disable clickhouse-server

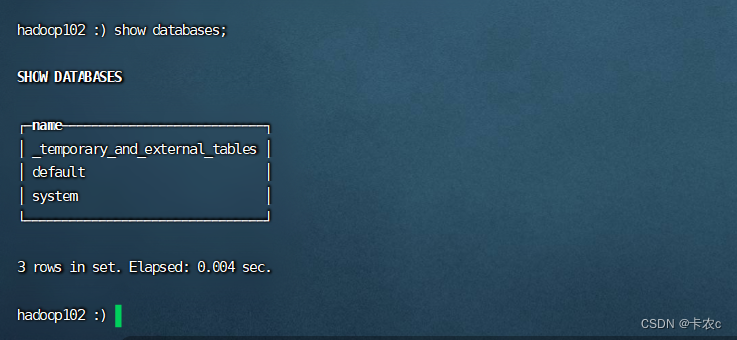

使用 client 连接 server

clickhouse-client -m

-m :可以在命令窗口输入多行命令

3.数据类型

整型

固定长度的整型,包括有符号整型或无符号整型

整型范围(-2n-1~2n-1-1):

Int8 - [-128 : 127]

Int16 - [-32768 : 32767]

Int32 - [-2147483648 : 2147483647]

Int64 - [-9223372036854775808 : 9223372036854775807]

无符号整型范围(0~2n-1):

UInt8 - [0 : 255]

UInt16 - [0 : 65535]

UInt32 - [0 : 4294967295]

UInt64 - [0 : 18446744073709551615]

使用场景: 个数、数量、也可以存储型 id

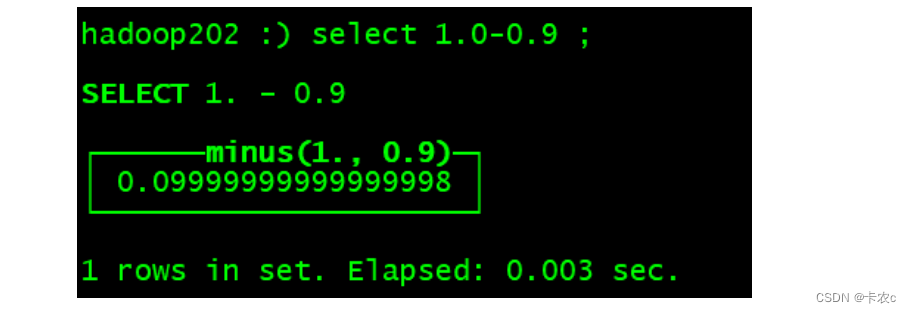

浮点型

Float32 - float

Float64 – double

建议尽可能以整数形式存储数据。例如,将固定精度的数字转换为整数值,如时间用毫秒为单位表示,因为浮点型进行计算时可能引起四舍五入的误差

布尔型

没有单独的类型来存储布尔值。可以使用 UInt8 类型,取值限制为 0 或 1

Decimal 型

有符号的浮点数,可在加、减和乘法运算过程中保持精度。对于除法,最低有效数字会被丢弃(不舍入)

有三种声明:

➢ Decimal32(s),相当于 Decimal(9-s,s),有效位数为 1~9

➢ Decimal64(s),相当于 Decimal(18-s,s),有效位数为 1~18

➢ Decimal128(s),相当于 Decimal(38-s,s),有效位数为 1~38

使用场景: 一般金额字段、汇率、利率等字段为了保证小数点精度,都使用 Decimal 进行 存储

字符串

➢ String

字符串可以任意长度的。它可以包含任意的字节集,包含空字节

➢ FixedString(N)

固定长度 N 的字符串,N 必须是严格的正自然数。当服务端读取长度小于 N 的字符串时候,通过在字符串末尾添加空字节来达到 N 字节长度。 当服务端读取长度大于 N 的字符串时候,将返回错误消息

使用场景:名称、文字描述、字符型编码。 固定长度的可以保存一些定长的内容,比如一些编码,性别等但是考虑到一定的变化风险,带来收益不够明显,所以定长字符串使用意义有限

枚举类型

包括 Enum8 和 Enum16 类型。Enum 保存 ‘string’= integer 的对应关系

Enum8 用 ‘String’= Int8 对描述

Enum16 用 ‘String’= Int16 对描述

➢ 用法演示

创建一个带有一个枚举 Enum8(‘hello’ = 1, ‘world’ = 2) 类型的列

CREATE TABLE t_enum

(

x Enum8('hello' = 1, 'world' = 2)

)

ENGINE = TinyLog;

➢ 这个 x 列只能存储类型定义中列出的值:‘hello’或’world’

只能插入hello和world

如果需要看到对应行的数值,则必须将 Enum 值转换为整数类型

hadoop102 :) SELECT CAST(x, 'Int8') FROM t_enum;

时间类型

目前 ClickHouse 有三种时间类型

➢ Date 接受年-月-日的字符串比如 ‘2019-12-16’

➢ Datetime 接受年-月-日 时:分:秒的字符串比如 ‘2019-12-16 20:50:10’

➢ Datetime64 接 受 年 - 月 - 日 时 : 分 : 秒 . 亚 秒 的 字 符 串 比 如 ‘ 2019-12-16 20:50:10.66’

4.引擎

表引擎是 ClickHouse 的一大特色。可以说, 表引擎决定了如何存储表的数据。包括:

➢ 数据的存储方式和位置,写到哪里以及从哪里读取数据

➢ 支持哪些查询以及如何支持

➢ 并发数据访问

➢ 索引的使用(如果存在)

➢ 是否可以执行多线程请求

➢ 数据复制参数

表引擎的使用方式就是必须显式在创建表时定义该表使用的引擎,以及引擎使用的相关参数

特别注意:引擎的名称大小写敏感

1.TinyLog

以列文件的形式保存在磁盘上,不支持索引,没有并发控制。一般保存少量数据的小表,生产环境上作用有限。可以用于平时练习测试用

如:

create table t_tinylog ( id String, name String) engine=TinyLog;

2.Memory

内存引擎,数据以未压缩的原始形式直接保存在内存当中,服务器重启数据就会消失。读写操作不会相互阻塞,不支持索引。简单查询下有非常非常高的性能表现(超过 10G/s)。一般用到它的地方不多,除了用来测试,就是在需要非常高的性能,同时数据量又不太大(上限大概 1 亿行)的场景

3.MergeTree

ClickHouse 中最强大的表引擎当属 MergeTree(合并树)引擎及该系列(MergeTree)中的其他引擎,支持索引和分区,地位可以相当于 innodb 之于 Mysql。 而且基于MergeTree,还衍生除了很多小弟,也是非常有特色的引擎

➢ 建表语句

create table t_order_mt(

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

) engine =MergeTree

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id);

我们根据时间分区,toYYYYMMDD是函数,按照年月日分区。按照order by排序(分区内生效),特别,clickhouse主键是不唯一的,主键的设定主要依据是查询语句中的 where 条件。根据条件通过对主键进行某种形式的二分查找,能够定位到对应的 index granularity,避免了全表扫描

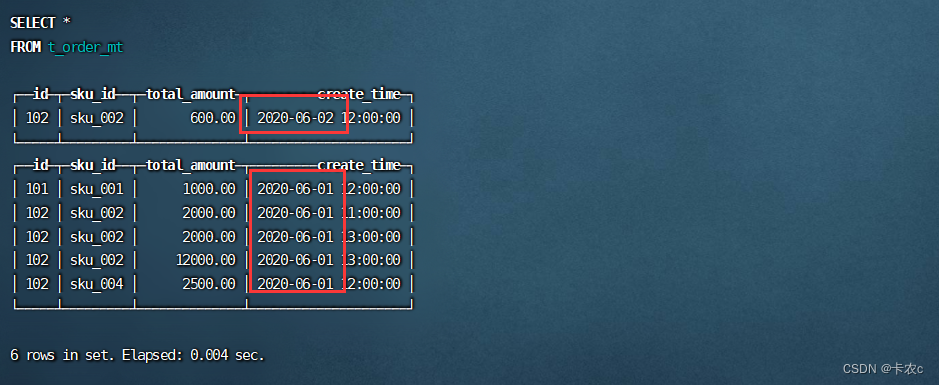

➢ 插入数据

insert into t_order_mt values

(101,'sku_001',1000.00,'2020-06-01 12:00:00') ,

(102,'sku_002',2000.00,'2020-06-01 11:00:00'),

(102,'sku_004',2500.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 13:00:00'),

(102,'sku_002',12000.00,'2020-06-01 13:00:00'),

(102,'sku_002',600.00,'2020-06-02 12:00:00');

MergeTree 其实还有很多参数(绝大多数用默认值即可),但是三个参数是更加重要的,也涉及了关于 MergeTree 的很多概念

partition by 分区(可选)

➢ 作用

分区的目的主要是降低扫描的范围,优化查询速度

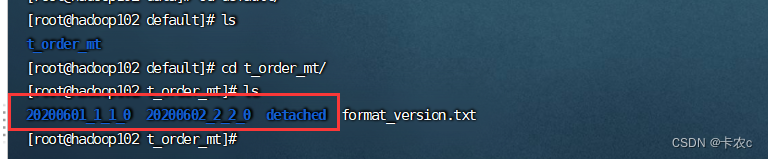

➢ 分区目录

MergeTree 是以列文件+索引文件+表定义文件组成的,但是如果设定了分区那么这些文件就会保存到不同的分区目录中

➢ 并行

分区后,面对涉及跨分区的查询统计,ClickHouse 会以分区为单位并行处理,我们看到,不同分区实际上是不同的文件

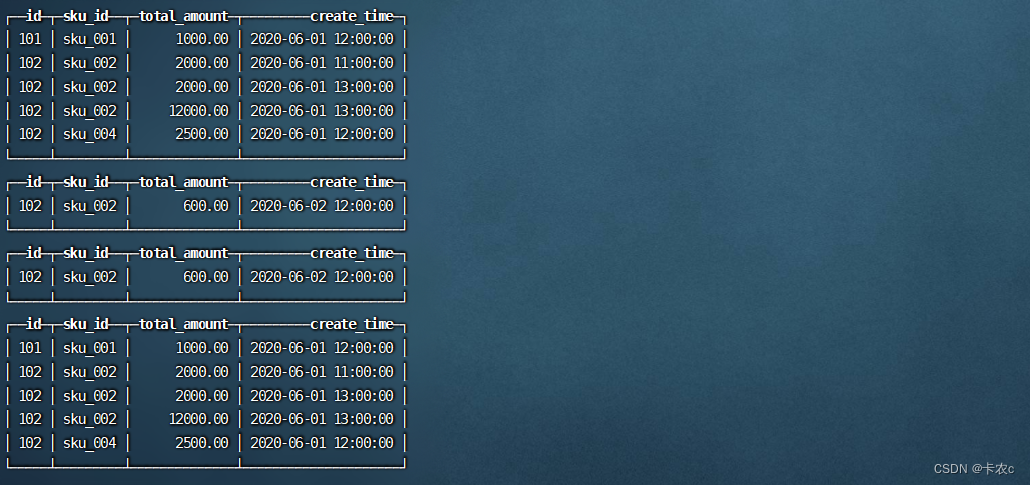

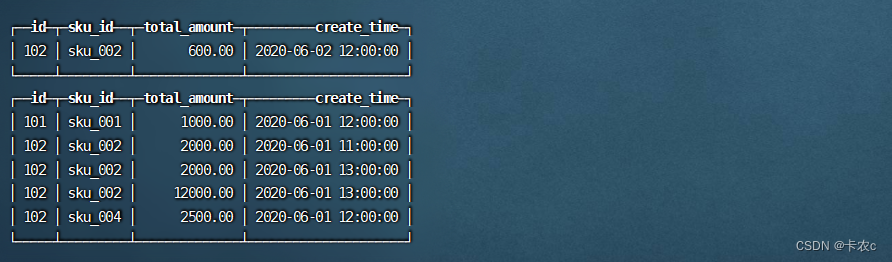

➢ 数据写入与分区合并

任何一个批次的数据写入都会产生一个临时分区,不会纳入任何一个已有的分区。写入后的某个时刻(大概 10-15 分钟后),ClickHouse 会自动执行合并操作(等不及也可以手动通过 optimize 执行),把临时分区的数据,合并到已有分区中

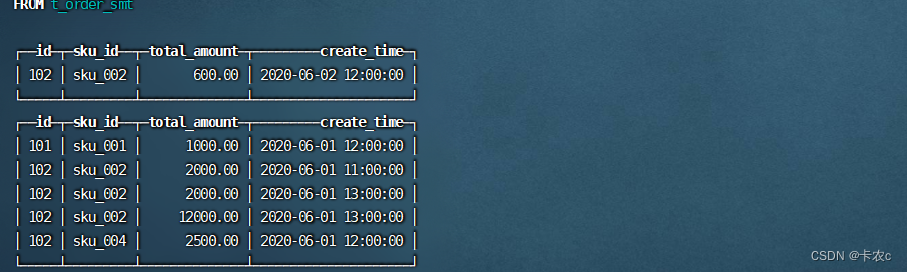

再插入一批数据

insert into t_order_mt values

(101,'sku_001',1000.00,'2020-06-01 12:00:00') ,

(102,'sku_002',2000.00,'2020-06-01 11:00:00'),

(102,'sku_004',2500.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 13:00:00'),

(102,'sku_002',12000.00,'2020-06-01 13:00:00'),

(102,'sku_002',600.00,'2020-06-02 12:00:00');

可以看到,并没有进行分区合并

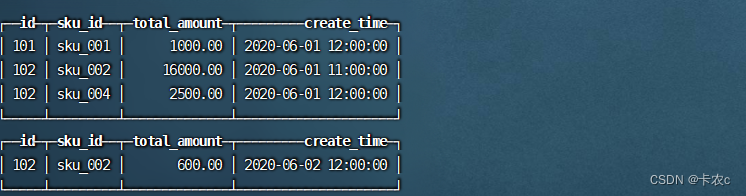

手动合并

optimize table t_order_mt final;

primary key 主键(可选)

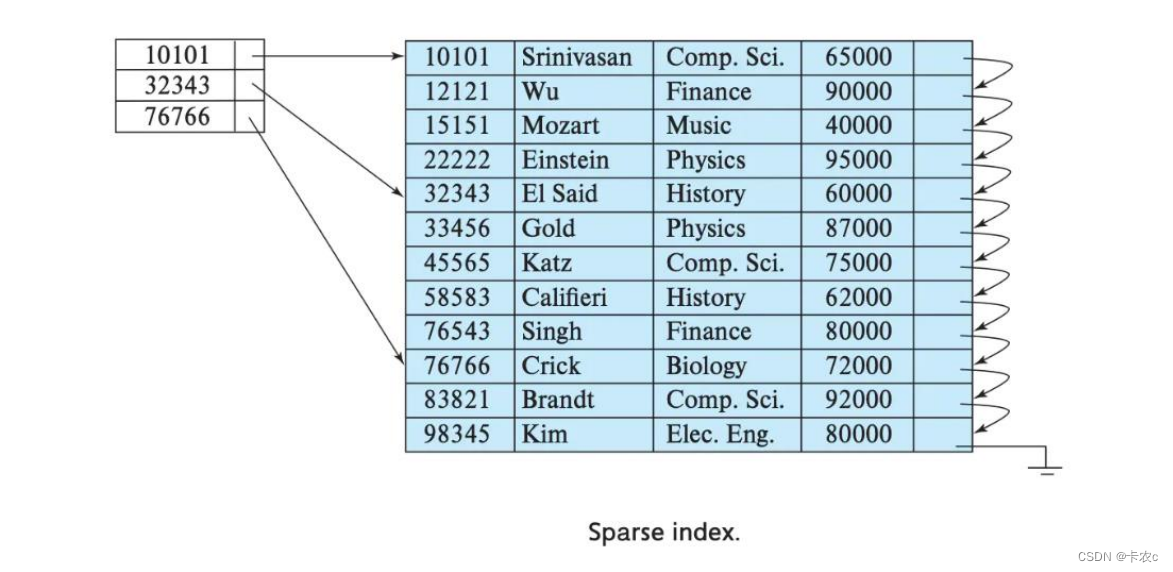

ClickHouse 中的主键,和其他数据库不太一样,它只提供了数据的一级索引,但是却不是唯一约束。这就意味着是可以存在相同 primary key 的数据的。主键的设定主要依据是查询语句中的 where 条件

根据条件通过对主键进行某种形式的二分查找,能够定位到对应的 index granularity,避免了全表扫描

index granularity: 直接翻译的话就是索引粒度,指在稀疏索引中两个相邻索引对应数据的间隔。ClickHouse 中的 MergeTree 默认是 8192。官方不建议修改这个值,除非该列存在大量重复值,比如在一个分区中几万行才有一个不同数据

稀疏索引的好处就是可以用很少的索引数据,定位更多的数据,代价就是只能定位到索引粒度的第一行,然后再进行进行一点扫描

order by(必选)

order by 设定了分区内的数据按照哪些字段顺序进行有序保存

order by 是 MergeTree 中唯一一个必填项,甚至比 primary key 还重要,因为当用户不设置主键的情况,很多处理会依照 order by 的字段进行处理(比如后面会讲的去重和汇总)

要求:主键必须是 order by 字段的前缀字段

比如 order by 字段是 (id,sku_id) 那么主键必须是 id 或者(id,sku_id),主键的作用是建立索引,必须有序,对于id和sku_id而言,id一定是有序的,而sku_id受id的影响,不一定是有序的,所以我们不能跳过id选择sku_id建立索引

数据 TTL

TTL create_time+interval 10 SECOND,10秒后过期,要根据实际时间做测试

create table t_order_mt2(

id UInt32,

sku_id String,

total_amount Decimal(16,2) TTL create_time+interval 10 SECOND,

create_time Datetime

) engine =MergeTree

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id, sku_id);

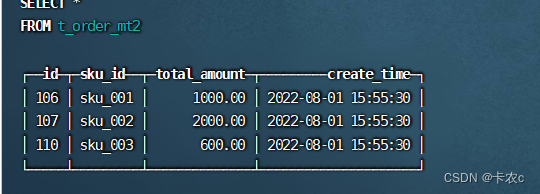

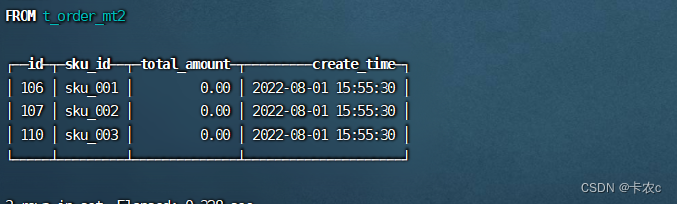

insert into t_order_mt2 values

(106,'sku_001',1000.00,'2022-08-01 15:55:30'),

(107,'sku_002',2000.00,'2022-08-01 15:55:30'),

(110,'sku_003',600.00,'2022-08-01 15:55:30');

手动合并,可以看到,数据变成了对应类型的默认值,但列并没有删除

optimize table t_order_mt2 final;

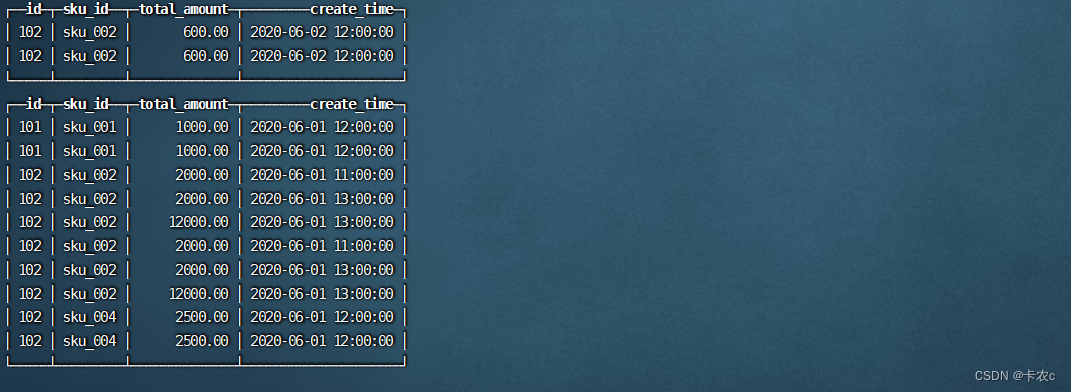

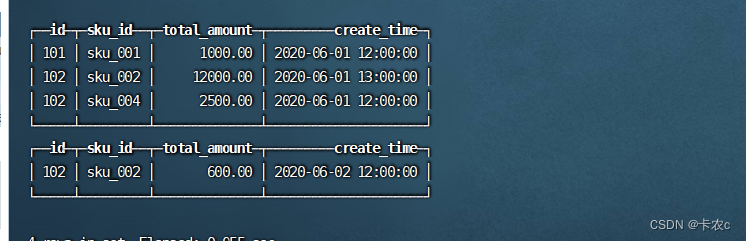

4.ReplacingMergeTree

ReplacingMergeTree 是 MergeTree 的一个变种,它存储特性完全继承 MergeTree,只是多了一个去重的功能。 尽管 MergeTree 可以设置主键,但是 primary key 其实没有唯一约束的功能。如果你想处理掉重复的数据,可以借助这个 ReplacingMergeTree,注意,是根据order_by的字段去重

create table t_order_rmt(

id UInt32,

sku_id String,

total_amount Decimal(16,2) ,

create_time Datetime

) engine = ReplacingMergeTree(create_time)

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id, sku_id);

上面的建表语句引擎用了ReplacingMergeTree,去重根据order by的字段id和sku_id,也就是不允许存在两个id和sku_id相同的行,那有相同的保留哪个呢?ReplacingMergeTree(arg) 填入的参数为版本字段,重复数据保留版本字段值最大的。如果不填版本字段,默认按照插入顺序保留最后一条,如果order_by字段相同,并且参数也相同,则保留最后插入的数据

insert into t_order_rmt values

(101,'sku_001',1000.00,'2020-06-01 12:00:00') ,

(102,'sku_002',2000.00,'2020-06-01 11:00:00'),

(102,'sku_004',2500.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 13:00:00'),

(102,'sku_002',12000.00,'2020-06-01 13:00:00'),

(102,'sku_002',600.00,'2020-06-02 12:00:00');

手动合并

OPTIMIZE TABLE t_order_rmt FINAL;

5.SummingMergeTree

对于不查询明细,只关心以维度进行汇总聚合结果的场景。如果只使用普通的MergeTree 的话,无论是存储空间的开销,还是查询时临时聚合的开销都比较大。ClickHouse 为了这种场景,提供了一种能够“预聚合”的引擎 SummingMergeTree

create table t_order_smt(

id UInt32,

sku_id String,

total_amount Decimal(16,2) ,

create_time Datetime) engine =SummingMergeTree(total_amount)

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id );

insert into t_order_smt values

(101,'sku_001',1000.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 11:00:00'),

(102,'sku_004',2500.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 13:00:00'),

(102,'sku_002',12000.00,'2020-06-01 13:00:00'),

(102,'sku_002',600.00,'2020-06-02 12:00:00');

手动合并

OPTIMIZE TABLE t_order_smt FINAL;

➢ 通过结果可以得到以下结论

◼ 以 SummingMergeTree()中指定的列作为汇总数据列

◼ 可以填写多列必须数字列,如果不填,以所有非维度列且为数字列的字段为汇总数据列

◼ 以 order by 的列为准,作为维度列

◼ 其他的列按插入顺序保留第一行

◼ 不在一个分区的数据不会被聚合

一个问题

能不能直接执行以下 SQL 得到汇总值

select total_amount from XXX where province_name=’’ and create_date=’xxx’

不行,可能会包含一些还没来得及聚合的临时明细

如果要是获取汇总值,还是需要使用 sum 进行聚合,这样效率会有一定的提高,但本身ClickHouse 是列式存储的,效率提升有限,不会特别明显

select sum(total_amount) from province_name=’’ and create_date=‘xxx’

二.SQL操作

1.insert

➢ 标准

insert into [table_name] values(…),(….)

➢ 从表到表的插入

insert into [table_name] select a,b,c from [table_name_2]

2.update 和 delete

➢ 删除操作

alter table t_order_smt delete where sku_id ='sku_001';

➢ 修改操作

alter table t_order_smt update total_amount=toDecimal32(2000.00,2) where id =102;

➢ 新增字段

alter table tableName add column newcolname String after col1;

➢ 修改字段类型

alter table tableName modify column newcolname String;

➢ 删除字段

alter table tableName drop column newcolname;

3.select

➢ 支持子查询

➢ 支持 CTE(Common Table Expression 公用表表达式 with 子句)

➢ 支持各种 JOIN, 但是 JOIN 操作无法使用缓存,所以即使是两次相同的 JOIN 语句,ClickHouse 也会视为两条新 SQL

➢ 窗口函数(官方正在测试中…)

➢ 不支持自定义函数

➢ GROUP BY 操作增加了 with rollup\with cube\with total 用来计算小计和总计

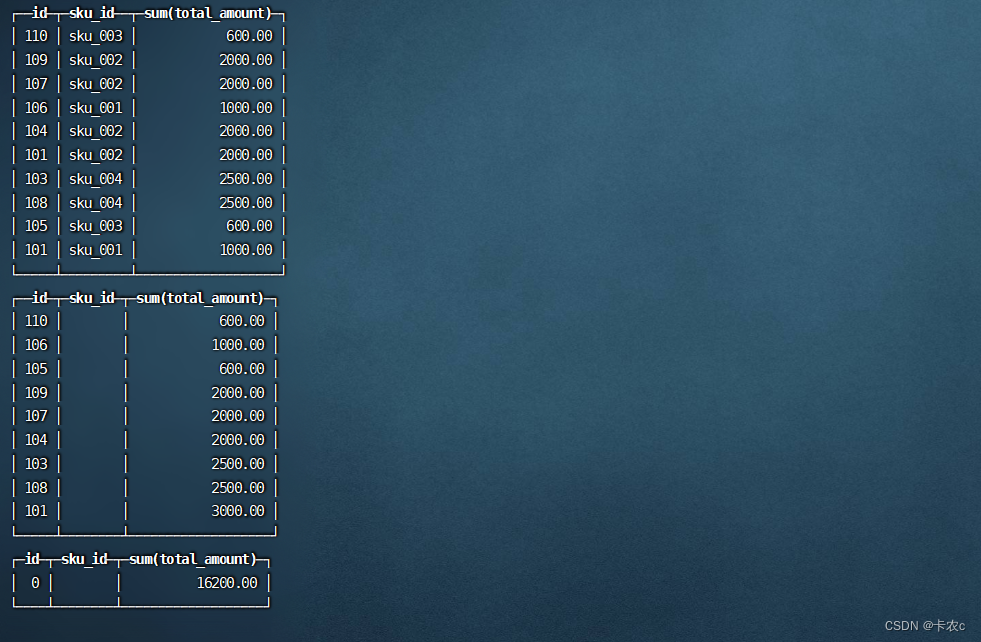

with rollup:从右至左去掉维度进行小计

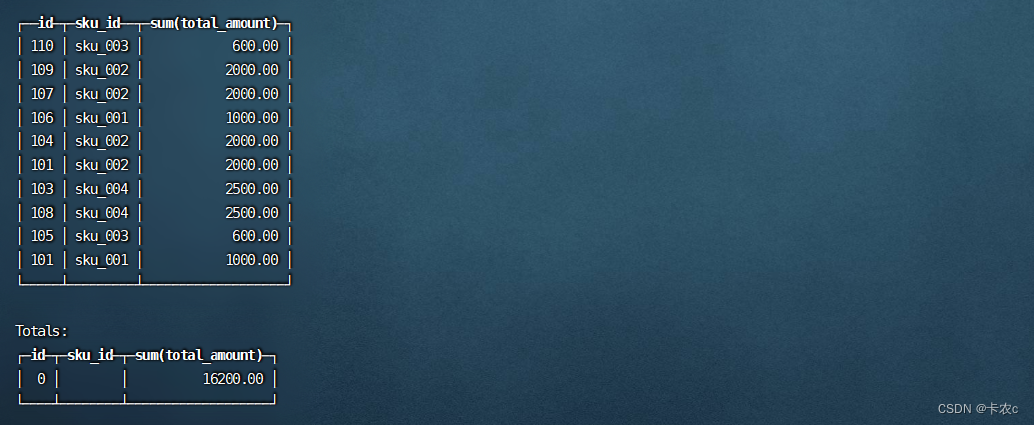

如图,由下表,我们group by id和sku_id,所以id和sku_id是维度

select id,sku_id,sum(total_amount) from t_order_mt group by id,sku_id;

select id,sku_id,sum(total_amount) from t_order_mt group by id,sku_id with rollup;

可以看到,结果分为了三部分,第一部分是全维度,也就是根据id和sku_id进行求和,第二部分就只剩了id维度,根据id求和,第三部分就没有维度了,全体求和

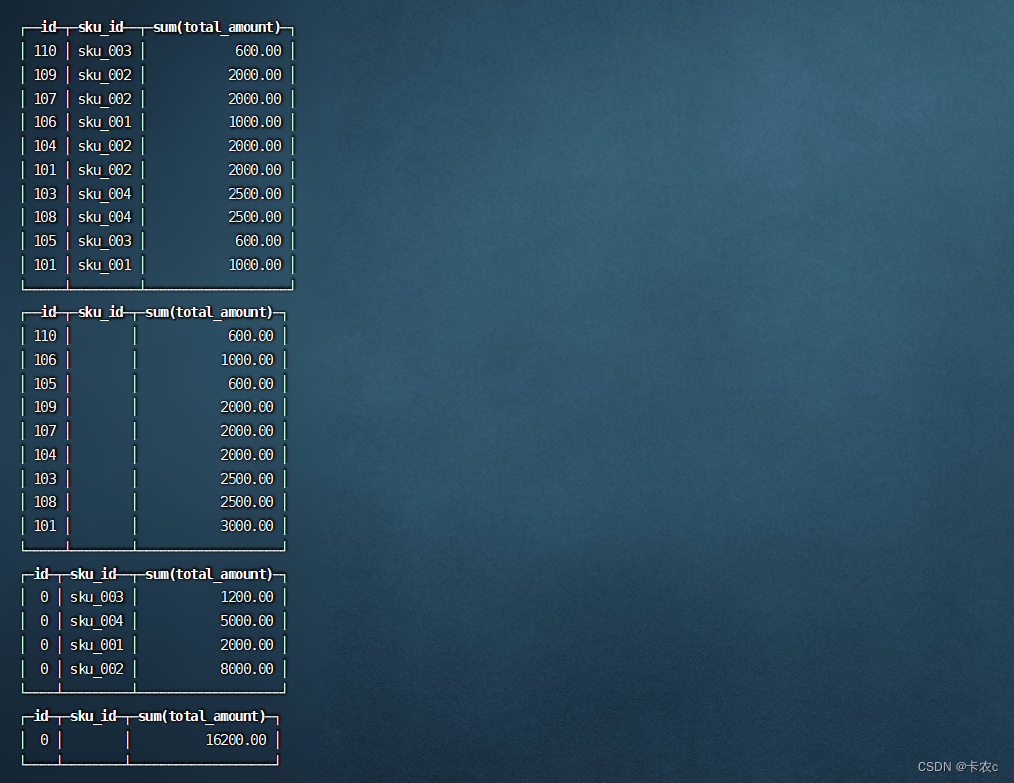

with cube : 从右至左去掉维度进行小计,再从左至右去掉维度进行小计,也就是所有维度组合都来一遍

select id , sku_id,sum(total_amount) from t_order_mt group by id,sku_id with cube;

2个维度,共4种组合

with totals: 只计算合计

select id,sku_id,sum(total_amount) from t_order_mt group by id,sku_id with totals;

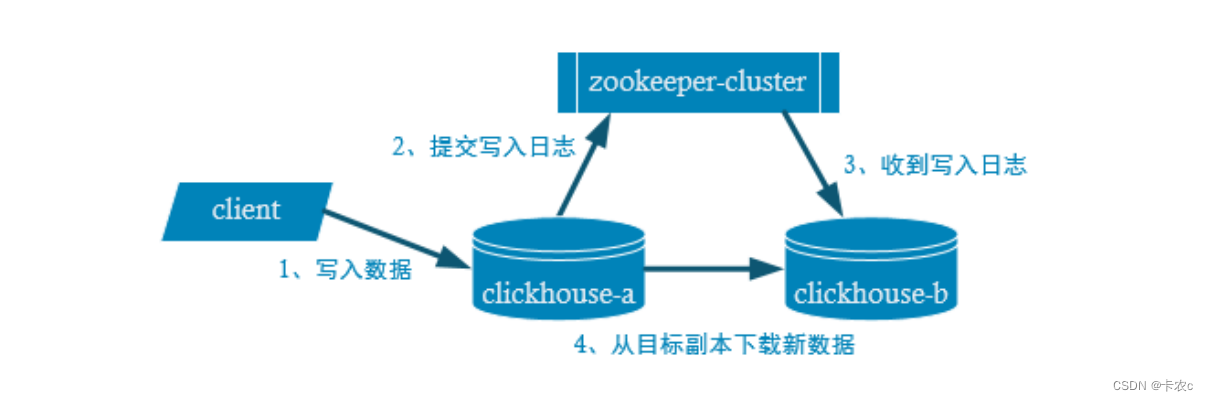

三.副本

副本的目的主要是保障数据的高可用性,即使一台 ClickHouse 节点宕机,那么也可以从其他服务器获得相同的数据

1.配置步骤

➢ 启动 zookeeper 集群

➢ 在hadoop102的/etc/clickhouse-server/config.d目录下创建一个名为metrika.xml的配置文件,内容如下:

<?xml version="1.0"?>

<yandex>

<zookeeper-servers>

<node index="1">

<host>hadoop102</host>

<port>2181</port>

</node>

<node index="2">

<host>hadoop103</host>

<port>2181</port>

</node>

<node index="3">

<host>hadoop104</host>

<port>2181</port>

</node>

</zookeeper-servers>

</yandex>

同步到另外两台机器

在 hadoop102 的/etc/clickhouse-server/config.xml 中增加

<include_from>/etc/clickhouse-server/config.d/metrika.xml</include_from>

同步到另外两台机器

重启clickhouse服务,起码两台服务器

2.副本测试

注意,副本只能同步数据,但是表结构不可以同步,想要副本的话必须要在服务器手动创建表

hadoop102

create table t_order_test (

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

) engine =ReplicatedMergeTree('/clickhouse/table/01/t_order_test','rep_102')

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id);

hadoop103

create table t_order_test(

id UInt32,

sku_id String,

total_amount Decimal(16,2),

create_time Datetime

) engine =ReplicatedMergeTree('/clickhouse/table/01/t_order_test','rep_103')

partition by toYYYYMMDD(create_time)

primary key (id)

order by (id,sku_id);

我们使用副本引擎 —— ReplicatedMergeTree ,第一个参数是分片的 zk_path 一般按照: /clickhouse/table/{shard}/{table_name} 的格式写,如果只有一个分片就写 01 即可。第二个参数是副本名称,相同的分片副本名称不能相同

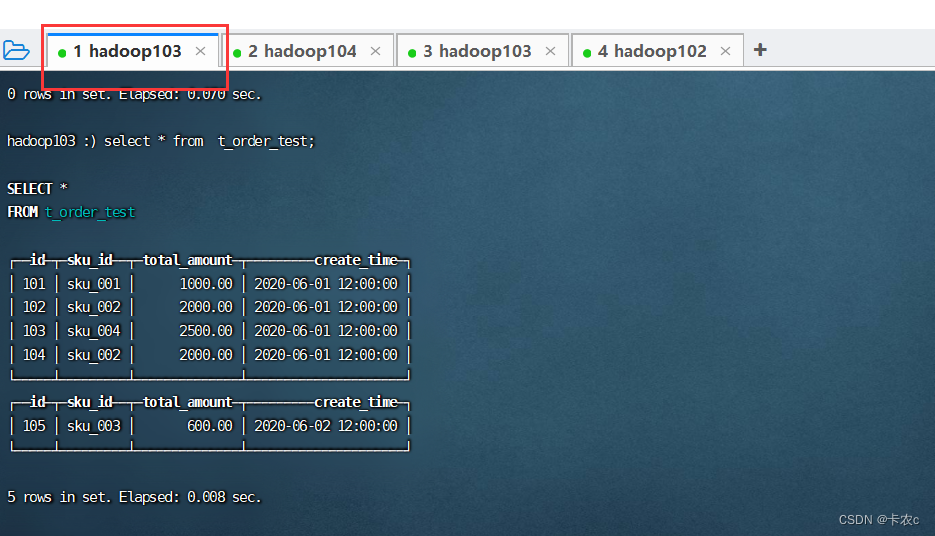

在 hadoop102 上执行 insert 语句

insert into t_order_test values

(101,'sku_001',1000.00,'2020-06-01 12:00:00'),

(102,'sku_002',2000.00,'2020-06-01 12:00:00'),

(103,'sku_004',2500.00,'2020-06-01 12:00:00'),

(104,'sku_002',2000.00,'2020-06-01 12:00:00'),

(105,'sku_003',600.00,'2020-06-02 12:00:00');

可以在103查到数据

四.Java API

<dependency>

<groupId>ru.yandex.clickhouse</groupId>

<artifactId>clickhouse-jdbc</artifactId>

<version>0.2.4</version>

<exclusions>

<exclusion>

<groupId>com.fasterxml.jackson.core</groupId>

<artifactId>jackson-databind</artifactId>

</exclusion>

<exclusion>

<groupId>com.fasterxml.jackson.core</groupId>

<artifactId>jackson-core</artifactId>

</exclusion>

</exclusions>

</dependency>